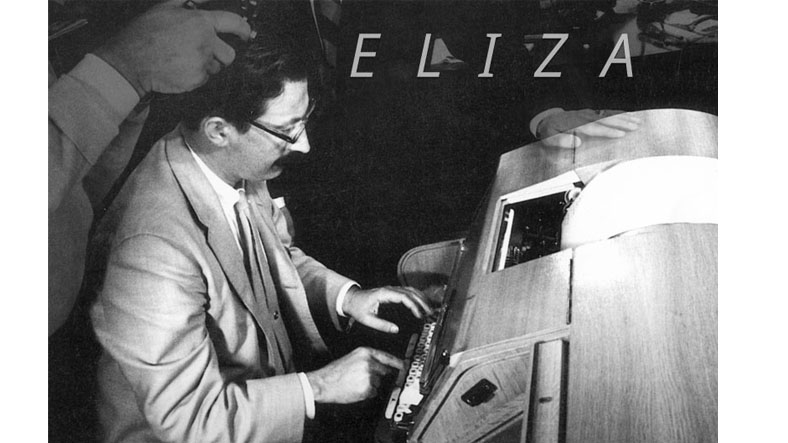

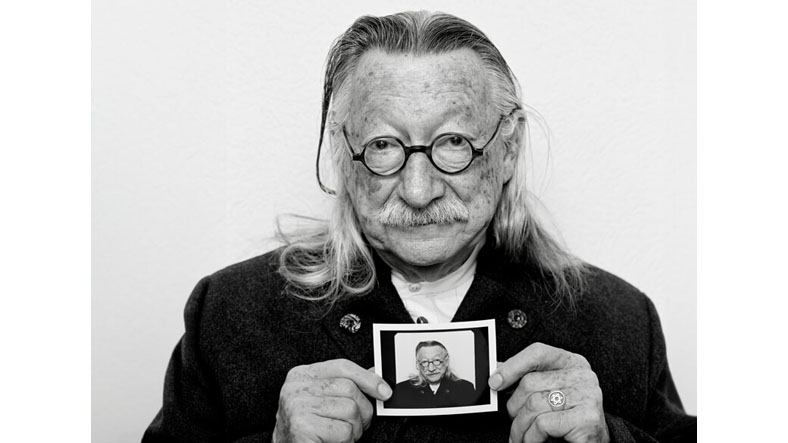

İnsanlarla tıpkı bugün olduğu gibi sohbet eden bu bot, ne oldu da mucidini kendisine düşman yapmıştı? Ya da sanılanın aksine Joseph Weizenbaum, onun değil, teknolojinin düşmanıydı. ELIZA, basit bir dil işleme programıydı. MIT’nin laboratuvarlarında dünyanın ilk sohbet botu ELIZA’yı geliştiren Weizenbaum, yapay zekânın sınırlarını keşfederken aslında insan doğasına dair çarpıcı gerçeklerle de yüzleşti.

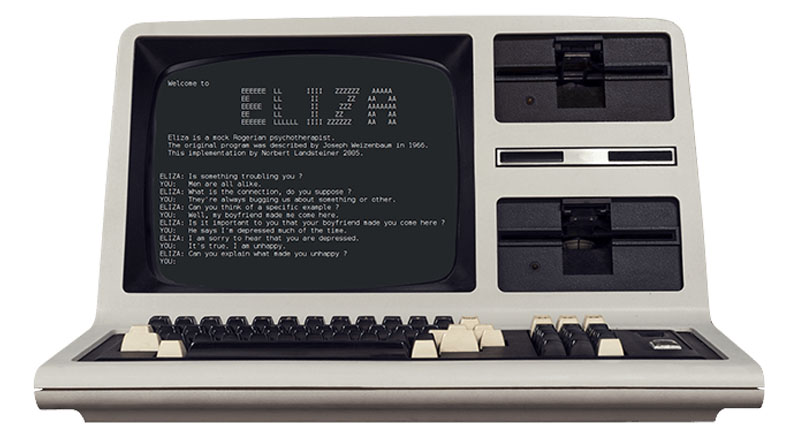

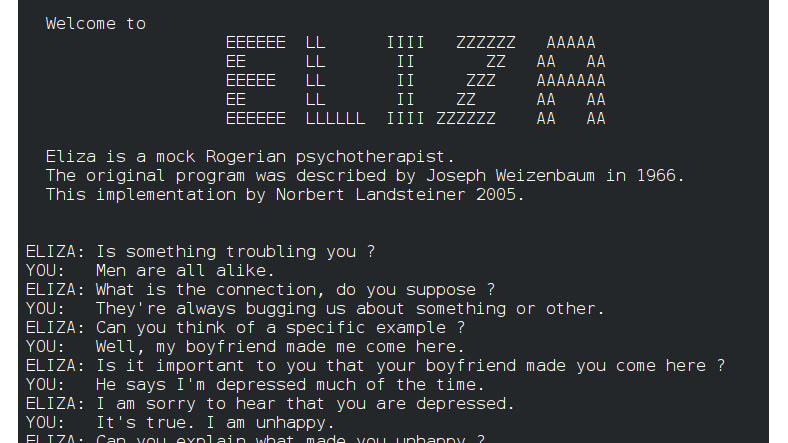

ELIZA, kullanıcının cümlelerindeki anahtar kelimeleri yakalıyor ve onları sorulara dönüştürüyordu. Tıpkı ChatGPT ile gerçekleştirdiğimiz sohbet tadında, ELIZA’ya da “Hayat çok kötü” dediğimizde, “Neden kötü hissediyorsun?” gibi sorularla diyaloğu sürdürebiliyorduk. Weizenbaum bu deneyi başlattığında, amacı insanların bir makineyle nasıl etkileşim kurduğunu gözlemlemekti. Ancak ELIZA’nın yarattığı etki, beklenmedik boyutlara ulaşmıştı.

Programın en ünlü senaryosu DOCTOR, psikoterapist Carl Rogers’ın yansıtıcı dinleme tekniklerini taklit ediyordu. İnsanlar, ekran karşısında bir terapistle konuşuyormuşçasına duygularını ELIZA’ya açıyorlardı. Bu durum, Weizenbaum’u rahatsız eden bir gerçeklik haline geldi. İnsanların, hiçbir gerçek anlayış yeteneği olmayan bir yazılıma bu kadar kolay güvenmesi, onu yapay zekânın etik boyutunu sorgulamaya sevk etti. “ELIZA Etkisi” adını verdiği bu olgu, insanların teknolojiye atfettiği anlamın, tehlikeli bir yanılsamaya dönüşebileceğini anlatmaya çalışıyordu.

Weizenbaum, ELIZA’nın başarısının ardından kariyerinde radikal bir dönüşüm yaşadı. 1976’da yayımladığı Computer Power and Human Reason adlı kitabında, insan ile makine arasındaki ontolojik farkı vurguluyordu. Ona göre bilgisayarlar yalnızca “hesaplama” yapabilirdi; insanın sahip olduğu “yargı” yetisi ise deneyimlerden, ahlaki değerlerden ve tarihsel bağlamdan besleniyordu. Tüm bu sebeplerden dolayı Weizenbaum, yapay zekânın insan hayatının belirli alanlarına müdahalesini “ahlaki bir sapkınlık” olarak nitelendirmeye başlamıştı.

Herkes, bu görüşlerinden sonra Weizenbaum’u teknoloji düşmanı ilan etti. Fakat Weizenbaum’un öngörüleri, günümüzde ChatGPT gibi dil modelleriyle yeniden gündeme geliyor. Günümüzde insanlar, bu araçlara duygusal bağlanıyor, kişisel sorunlarını anlatıyor ve hatta fal baktırıyorlar. Özellikle TikTok gibi platformlarda “ChatGPT’ye şunu sorun, verdiği cevaba inanamayacaksınız” gibi birçok akımı görmek mümkün. Bu noktada, Weizenbaum’un neden böyle düşündüğünü anlamamak elde değil.

Weizenbaum’a göre insanlık, teknolojiyi yönetmek yerine ona boyun eğdikçe kendi insanlıklarını da kaybediyor. Bu düşüncesini destekleyen bir örnek ise oldukça çarpıcı: Bir askerin, drone ile öldürdüğü insanları görmemesi, vicdani sorumluluğunu azalttığı için onu daha duyarsız bir hâle getirebiliyor. Aslında o, teknolojik ilerlemeye değil; onun, insani değerlerin önüne geçmesine karşıydı.

“Bilgisayarlar bize ne yapmamız gerektiğini söylememeli, sadece nasıl yapacağımızı göstermeli” fikrine hâkim olan Weizenbaum, ELIZA’yı yaratmasına rağmen yapay zekânın karanlık potansiyelini ilk görenlerden biriydi. Artık ChatGPT ile sohbet ederken belki de Weizenbaum’un şu sözlerini hatırlarız: “Bir şeyi yapabiliyor olmamız, yapmamız gerektiği anlamına gelmez. İnsan olmanın anlamını korumak, teknolojiden daha değerlidir.”

Kaynaklar: 1, 2, 3

Kaynak: Webtekno